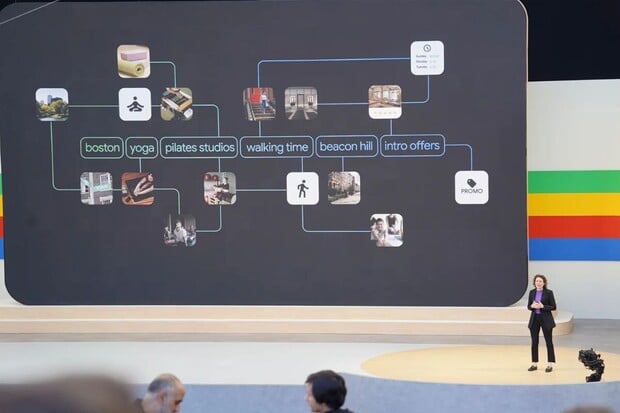

Mezi řadou AI nástrojů, které Google představil na letošní konferenci Google I/O byl i nástroj AI Overview, který si klade za cíl proměnit to, jakým způsobem hledáme informace na internetu. Namísto řady odkazů na související stránky přijde rovnou s odpovědí. Jenže jak se dalo čekat, vzhledem k povaze systému to nemusí být úplně šťastné řešení. Některým uživatelům radil, aby si do pizzy dali lepidlo, některým doporučoval jíst kameny a tvrdil, že Barack Obama je muslimský prezident. Zatímco se uživatelé setkávali s podivnými odpověďmi vyhledávače, společnost Google oficiálně vydala reakci a začala pracovat na opravách.

Vedoucí oddělení vyhledávání Google Liz Reidová se k nesmyslným a nepřesným odpovědím společnosti Google vyjádřila v příspěvku na blogu. Z příspěvku vyplývá, že většina problémů s přehledy AI je způsobena dotazy uživatelů a webovými stránkami, ze kterých čerpá data, nikoli společností Google. A pokud jde o tu část, za kterou Google skutečně může, pracuje na ní.

AI Overviews se liší od ostatních chatbotů a nástrojů s velkým jazykovým modelem. Funkce je poháněna jazykovými modely společnosti Google, ale neposkytuje výsledky z jejích tréninkových dat. Místo toho získává relevantní a kvalitní výsledky z indexu vyhledávání Google a poskytuje souhrnný textový výstup z těchto webových stránek. Přehledy AI zobrazují pouze informace z nejlepších výsledků webu a samy o sobě nic neříkají. A když se v něčem splete, je to z důvodů, jako je „špatná interpretace dotazů, špatná interpretace jazykových nuancí na webu nebo nedostatek kvalitních informací“. Nebo, jak Google nenápadně naznačuje, to může být prostě chyba uživatelů.

Část chybných odpovědí jsou také prosté podvrhy. Týká se to takových případů, které se masivně šíří po sociálních sítích, kdy je například osobám s depresí doporučován skok z mostu nebo těhotným matkám kouření.

Další řada nesmyslných odpovědí vzniká jako odpověď na nesmyslnou otázku. Ukazuje se to na příkladu dotazu „Kolik kamenů bych měl sníst?“, který vedl k tomu, že přehled umělé inteligence navrhl, aby někteří uživatelé snědli alespoň jeden malý kámen denně. O tomto tématu bylo na Googlu k dispozici jen málo nebo žádné kvalitní výsledky a umělá inteligence našla satirický obsah zveřejněný na webových stránkách vývojáře softwaru, který nedokázala interpretovat jako satiru. To je případ i mnoha dalších chybných odpovědí, jako je třeba často zmiňované „lepidlo na pizze“. Pokud vyhledávač nenajde kvalitní obsah, sáhne například po balastu na sociálních sítích, kde se to jen hemží ironií a trollením.